ANDREJ KARPATHY CHIA SẺ TẤT TẦN TẬT VỀ CÁCH DÙNG LLM: TỪ CƠ BẢN ĐẾN NÂNG CAO

· 13 phút để đọc

Nguồn: Bình dân học AI

Facebook: "https://www.facebook.com/frank.t96/"

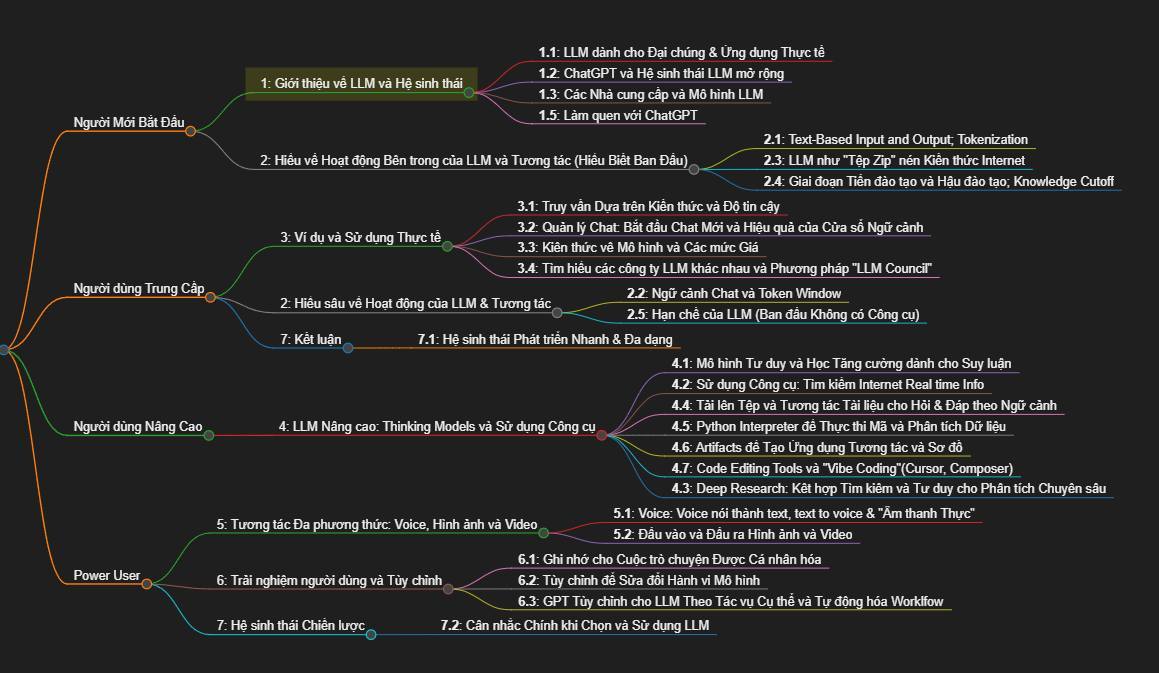

Thánh LLM Andrej Karpathy vừa có video dài 2h "How I use LLMs" chia sẻ về cách dùng LLM. Bài giảng chia thành 4 phần đi từ dễ đến khó.

NGƯỜI MỚI BẮT ĐẦU

1. Giới thiệu về Mô hình Ngôn ngữ Lớn (LLM) và Hệ sinh thái Hiện tại

1.1. LLM dành cho Đại chúng & Ứng dụng Thực tế

- Video này tiếp tục loạt video về LLM cho khán giả đại chúng, tập trung vào các ứng dụng thực tế và cách người xem có thể sử dụng chúng trong cuộc sống và công việc.

1.2. Sự trỗi dậy của ChatGPT và Hệ sinh thái LLM đang mở rộng

- ChatGPT, được phát triển bởi OpenAI vào năm 2022, đã trở nên phổ biến rộng rãi như một giao diện trò chuyện văn bản với LLM.

- Từ đó, hệ sinh thái LLM đã phát triển mạnh mẽ, với nhiều ứng dụng tương tự ChatGPT xuất hiện vào năm 2025.

1.3. Sự đa dạng của các Nhà cung cấp và Mô hình LLM

- ChatGPT là LLM tiên phong, phổ biến và giàu tính năng nhất do ra đời sớm nhất, nhưng có nhiều bản sao và trải nghiệm độc đáo khác.

- Các công ty công nghệ lớn như Google (Gemini), Meta (met) và Microsoft (Copilot) đã phát triển các trải nghiệm tương tự ChatGPT, cùng với các công ty khởi nghiệp như Anthropic (Claude) và xAI (Grok).

- Các công ty LLM cũng đến từ nhiều quốc gia khác nhau, ví dụ DeepSeek (Trung Quốc), Mistral và lchat (Pháp).

1.4. Tập trung vào OpenAI (ChatGPT) như một Điểm Khởi đầu

- Video sẽ bắt đầu với OpenAI vì ChatGPT là mô hình đương nhiệm và giàu tính năng nhất, sau đó sẽ giới thiệu các mô hình khác theo thời gian.

2. Hiểu về Hoạt động Bên trong của LLM và Tương tác (Hiểu Biết Ban Đầu)

2.1. Đầu vào và Đầu ra Dựa trên Văn bản; Mã hóa token

- Tương tác cơ bản với LLM là cung cấp văn bản và nhận lại văn bản phản hồi.

- Bên trong, truy vấn và phản hồi được chia nhỏ thành các đoạn văn bản nhỏ gọi là token.

- Ứng dụng Tiktokenizer có thể được sử dụng để xem các token này.

2.2. LLM như "Tệp Zip" chứa Kiến thức Internet Nén

- Giai đoạn tiền đào tạo của LLM giống như nén toàn bộ Internet thành một "tệp zip" xác suất và mất mát.

- "Tệp zip" này chứa các tham số của mạng thần kinh, ví dụ, 1 TB có thể tương ứng với 1 nghìn tỷ tham số.

- LLM là một thực thể khép kín, giống như một "tệp zip" chứa các tham số mạng thần kinh.

2.3. Giai đoạn Tiền đào tạo và Hậu đào tạo; Ngưỡng Kiến thức

- Đào tạo LLM gồm hai giai đoạn chính: tiền đào tạo và hậu đào tạo.

- Mô hình LLM có "ngưỡng kiến thức" vì chúng chỉ biết đến thông tin đến thời điểm tiền đào tạo.

- Giai đoạn hậu đào tạo tập trung vào việc biến LLM thành một trợ lý hữu ích, phản hồi các truy vấn của người dùng theo phong cách trò chuyện.

NGƯỜI DÙNG TRUNG CẤP

3. Ví dụ và Cân nhắc Sử dụng Thực tế

3.1. Truy vấn Dựa trên Kiến thức và Độ tin cậy

- Video sẽ sử dụng các ví dụ thực tế để minh họa cách sử dụng LLM. Ví dụ, hỏi ChatGPT về lượng caffeine trong một shot Americano.

- Truy vấn dựa trên kiến thức phù hợp nên hỏi về thông tin phổ biến, không quá mới mẻ mà mô hình có thể đã được đào tạo.

- Câu trả lời của LLM là sự "nhớ lại" xác suất, không đảm bảo chính xác hoàn toàn, cần xác minh từ các nguồn chính thống.

- Người dùng không nên hoàn toàn tin tưởng vào đầu ra của LLM vì đó chỉ là sự nhớ lại thống kê xác suất của internet.

3.2. Quản lý Cuộc trò chuyện: Bắt đầu Cuộc trò chuyện Mới và Hiệu quả của Cửa sổ Ngữ cảnh

- Khi chuyển chủ đề, nên bắt đầu cuộc trò chuyện mới để xóa cửa sổ ngữ cảnh.

- Token trong cửa sổ ngữ cảnh tốn kém về mặt tính toán và có thể làm mô hình xao nhãng, giảm độ chính xác và làm chậm tốc độ phản hồi.

- Cửa sổ ngữ cảnh giống như bộ nhớ làm việc của mô hình, nên giữ ngắn gọn và chỉ chứa thông tin liên quan.

3.3. Nhận thức về Mô hình và Bậc Giá

- Người dùng cần lưu ý mô hình LLM đang sử dụng, thường được hiển thị ở góc trên bên trái giao diện.

- Các công ty cung cấp nhiều bậc giá khác nhau, với các mô hình khác nhau. Ví dụ, ChatGPT có các bậc Miễn phí, Plus và Pro, với các mô hình như GPT-4o Mini và GPT-4o.

- Mô hình lớn hơn thường mạnh mẽ hơn (sáng tạo, kiến thức rộng hơn, ít ảo giác hơn) nhưng đắt hơn.

- Người dùng nên cân nhắc chi phí và lợi ích của các mô hình khác nhau tùy theo nhu cầu sử dụng.

3.4. Khám phá các Nhà cung cấp LLM khác nhau và Phương pháp "Hội đồng LLM"

- Nên khám phá các nhà cung cấp LLM khác nhau như Claude (Anthropic), Gemini (Google) và Grok (xAI).

- Các nhà cung cấp khác nhau có các mô hình và bậc giá khác nhau. Ví dụ, Claude có các gói miễn phí và Pro với các mô hình khác nhau như Haiku và Sonnet.

- Người dùng có thể thử nghiệm và so sánh các mô hình khác nhau để tìm ra mô hình phù hợp nhất.

- Tác giả gợi ý sử dụng "Hội đồng LLM", tức là hỏi cùng một câu hỏi cho nhiều mô hình để có được nhiều quan điểm khác nhau.

4. Hiểu về Hoạt động Bên trong của LLM và Tương tác (Đi sâu hơn)

4.1. Ngữ cảnh Đàm thoại và Cửa sổ Token

- Cuộc trò chuyện với LLM diễn ra trong "cửa sổ ngữ cảnh", là bộ nhớ làm việc của mô hình.

- Cửa sổ ngữ cảnh chứa chuỗi token của cuộc trò chuyện, bao gồm cả truy vấn của người dùng và phản hồi của mô hình.

- Mô hình sử dụng cửa sổ ngữ cảnh để duy trì ngữ cảnh và tham khảo thông tin từ các lượt trò chuyện trước đó.

4.2. Hạn chế của LLM như "Tệp Zip" (Ban đầu Không có Công cụ)

- Ban đầu, LLM chỉ là một "tệp zip" khép kín, không có công cụ bên ngoài như máy tính, trình thông dịch Python hoặc trình duyệt web.

- LLM chỉ phản hồi bằng văn bản dựa trên kiến thức đã được đào tạo, không có khả năng truy cập thông tin thời gian thực hoặc thực hiện các tác vụ tính toán phức tạp.

5. Tóm tắt và Suy nghĩ Kết luận về Bối cảnh LLM (Điều hướng Hệ sinh thái)

5.1. Hệ sinh thái Phát triển Nhanh chóng và Thịnh vượng

- Hệ sinh thái ứng dụng LLM đang phát triển nhanh chóng và mạnh mẽ, với ChatGPT là người dẫn đầu nhưng nhiều ứng dụng khác đang nhanh chóng bắt kịp và thậm chí vượt trội.

NGƯỜI DÙNG NÂNG CAO

6. Khả năng LLM Nâng cao: Thinking model và Sử dụng Công cụ

6.1. Thinking model và Học Tăng cường để Suy luận

- Các "Thinking model" được đào tạo bằng học tăng cường để phát triển khả năng suy luận, giống như cách con người giải quyết vấn đề.

- Các mô hình này có khả năng thử nghiệm ý tưởng, xem xét lại giả định và suy nghĩ sâu hơn, dẫn đến độ chính xác cao hơn trong các tác vụ phức tạp như toán học, mã hóa và lý luận.

- Thinking model có thể mất nhiều thời gian hơn để phản hồi vì chúng thực hiện quá trình "suy nghĩ" sâu rộng hơn.

6.2. Sử dụng Công cụ: Tìm kiếm Internet để Lấy Thông tin Theo Thời gian Thực

- Để vượt qua giới hạn "ngưỡng kiến thức", LLM có thể được trang bị công cụ tìm kiếm internet.

- Khi sử dụng công cụ tìm kiếm, LLM có thể truy cập thông tin mới nhất từ web, đưa nội dung trang web vào cửa sổ ngữ cảnh và trả lời các câu hỏi về thông tin đó.

- Tính năng này đặc biệt hữu ích cho các truy vấn về thông tin gần đây hoặc thay đổi theo thời gian.

6.3. Tải lên Tệp và Tương tác Tài liệu cho Hỏi & Đáp theo Ngữ cảnh

- LLM có thể được cung cấp tài liệu cụ thể bằng cách tải lên tệp.

- Tài liệu tải lên sẽ được đưa vào cửa sổ ngữ cảnh, cho phép LLM trả lời các câu hỏi dựa trên nội dung của tài liệu đó.

- Tính năng này hữu ích cho việc đọc hiểu tài liệu chuyên ngành, nghiên cứu hoặc phân tích văn bản dài.

6.4. Trình thông dịch Python để Thực thi Mã và Phân tích Dữ liệu

- LLM có thể được trang bị trình thông dịch Python để thực thi mã và thực hiện các tác vụ tính toán.

- Khi cần tính toán hoặc phân tích dữ liệu, LLM có thể viết mã Python, thực thi mã đó và sử dụng kết quả để trả lời người dùng.

- Tính năng "Phân tích Dữ liệu Nâng cao" của ChatGPT là một ví dụ về việc sử dụng trình thông dịch Python để tạo biểu đồ và phân tích dữ liệu.

6.5. Artifacts để Tạo Ứng dụng Tương tác và Sơ đồ

- Tính năng "Artifacts" của Claude cho phép LLM tạo ra các ứng dụng web tương tác và sơ đồ trực tiếp trong trình duyệt.

- LLM có thể viết mã (ví dụ: React) để tạo các ứng dụng đơn giản hoặc sử dụng thư viện Mermaid để tạo sơ đồ khái niệm.

- Tính năng này hữu ích cho việc tạo các công cụ tùy chỉnh nhỏ hoặc trực quan hóa thông tin.

6.6. Công cụ Chỉnh sửa Mã và "Mã hóa Rung cảm" (Cursor, Composer)

- Các công cụ chỉnh sửa mã chuyên dụng như Cursor và Composer tích hợp LLM vào quy trình làm việc mã hóa chuyên nghiệp.

- Composer là một "tác nhân tự trị" có thể chỉnh sửa mã trên nhiều tệp, tự động hóa nhiều tác vụ lập trình và hỗ trợ "mã hóa rung cảm" - lập trình dựa trên chỉ dẫn cấp cao.

6.7. Nghiên cứu Sâu: Kết hợp Tìm kiếm và Tư duy cho Phân tích Chuyên sâu

- "Deep Research" là một tính năng nâng cao kết hợp tìm kiếm internet và Thinking model để thực hiện nghiên cứu chuyên sâu.

- LLM sẽ thực hiện nhiều tìm kiếm, phân tích tài liệu và suy nghĩ trong thời gian dài (hàng chục phút) để tạo ra báo cáo chi tiết về một chủ đề cụ thể.

- Tính năng này hữu ích cho việc nghiên cứu các chủ đề phức tạp, thu thập thông tin từ nhiều nguồn và tổng hợp thành báo cáo.

NGƯỜI DÙNG THÀNH THẠO

7. Tương tác Đa phương thức: Giọng nói, Hình ảnh và Video

7.1. Tương tác Giọng nói: Chuyển giọng nói thành văn bản, Chuyển văn bản thành giọng nói và "Âm thanh Thực"

- LLM có thể tương tác trực tiếp bằng giọng nói thông qua "âm thanh thực", xử lý âm thanh ở cấp độ token thay vì chỉ phiên âm thành văn bản.

- "Âm thanh thực" cho phép LLM hiểu và tạo ra giọng nói tự nhiên hơn, với nhiều sắc thái và biểu cảm.

- Grok là một LLM khác cung cấp chế độ giọng nói nâng cao với nhiều tính cách khác nhau.

- NotebookLM của Google có thể tạo podcast tùy chỉnh từ tài liệu văn bản, cho phép người dùng "nghe" thông tin thay vì chỉ đọc.

7.2. Đầu vào và Đầu ra Hình ảnh và Video

- LLM có thể xử lý và tạo ra hình ảnh và video bằng cách biểu diễn chúng dưới dạng token.

- LLM có thể phân tích hình ảnh (ví dụ: nhãn dinh dưỡng, kết quả xét nghiệm máu) và trả lời các câu hỏi liên quan.

- DALL-E là một mô hình của OpenAI có thể tạo ra hình ảnh từ lời nhắc văn bản.

- Các công cụ tạo video AI đang phát triển nhanh chóng và có thể tạo ra video chất lượng cao từ văn bản hoặc hình ảnh đầu vào.

8. Trải nghiệm Người dùng và Tùy chỉnh

8.1. Tính năng Ghi nhớ cho Cuộc trò chuyện Được Cá nhân hóa

- Tính năng ghi nhớ cho phép LLM lưu giữ thông tin từ các cuộc trò chuyện trước đó, tạo ra trải nghiệm cá nhân hóa hơn.

- LLM có thể "nhớ" sở thích, thông tin cá nhân và các cuộc trò chuyện trước đây để cung cấp phản hồi phù hợp hơn.

8.2. Hướng dẫn Tùy chỉnh để Sửa đổi Hành vi Mô hình

- Hướng dẫn tùy chỉnh cho phép người dùng tinh chỉnh hành vi, tính cách và phong cách phản hồi của LLM trên toàn cầu.

- Người dùng có thể hướng dẫn LLM về giọng điệu, vai trò và các đặc điểm mong muốn để tạo ra trải nghiệm phù hợp với nhu cầu cá nhân.

8.3. GPT Tùy chỉnh cho LLM Theo Tác vụ Cụ thể và Tự động hóa Quy trình làm việc

- GPT tùy chỉnh cho phép người dùng tạo ra các phiên bản LLM chuyên biệt cho các tác vụ cụ thể, giúp tự động hóa quy trình làm việc.

- Bằng cách cung cấp hướng dẫn chi tiết và ví dụ, người dùng có thể "lập trình" GPT tùy chỉnh để thực hiện các nhiệm vụ chuyên biệt như dịch thuật chi tiết hoặc trích xuất từ vựng.

9. Tóm tắt và Suy nghĩ Kết luận về Bối cảnh LLM (Điều hướng Hệ sinh thái Chiến lược)

- Khi chọn và sử dụng LLM, cần cân nhắc nhiều yếu tố như bậc giá, mô hình, khả năng suy luận, công cụ tích hợp, phương thức tương tác và các tính năng chất lượng cuộc sống.

- Việc hiểu rõ các yếu tố này giúp người dùng đưa ra quyết định sáng suốt và tối đa hóa hiệu quả sử dụng LLM cho các mục tiêu cụ thể.

#Andrej_Karpathy #LLM_video #video #tutorial